| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

- YOLO detection

- 프로그래머스 42839번

- 백준 1325번

- 가상환경 확인

- DeepLabv3+

- augmentation 이후 이미지 확인

- MMdetection

- 프로그래머스 보석 쇼핑

- Kullback-Leibler Divergence

- 프로그래머스 42885번

- 프로그래머스 42883번

- 백준 3190번

- 백준 효율적인 해킹

- 프로그래머스 72410번

- Optimization algorithms

- gradient descent optimization

- pytorch 이미지 확인

- object detection

- 원격서버 로컬 동기화

- 카카오 보석 쇼핑

- 프로그래머스 43164번

- 가상환경 제거

- 프로그래머스 67256번

- jupyter 명령어 모드 단축키

- 프로그래머스 67258번

- zip 압축해제 명령어

- jupyter 셀 추가 단축키

- os 확인 명령어

- 프로그래머스 67257번

- vscode sftp

- Today

- Total

소소한 블로그

[1주차 - Day4] MLE(maximum likelihood estimation) 본문

AI Math 7강에서 나오는 MLE(maximum likelihood estimation)에 대해 정리해봤습니다.

학부 때 분명히 전공 수업을 열심히 들었는데 그때 배운 지식이 어디론가 모두 증발해버렸습니다ㅎㅎ

강의에 나오는 것 중심으로 정리해봤습니다.

일단 MLE를 설명하기 전에 Parametric method 개념을 알아야 합니다.

데이터의 집합이 있다고 가정합니다.

만약 이 데이터 집합이 특정 확률분포를 따른다고 가정한다면,

그 분포를 결정하는 parmameter가 있을 것입니다.

쉬운 예시로 데이터가 정규분포를 따른다고 했을 때, 평균과 표준편차가 해당 확률분포의 parameter가 됩니다.

위와 같이 특정 확률분포를 따를 것이라고 가정하고 parameter를 추정하는 방법을 parametric method라고 합니다.

(참고로 parameter는 모수라는 뜻입니다.)

그렇다면 이러한 parameter들은 어떻게 찾아내야 할까요?

MLE는 바로 이 parameter를 찾는 방법 중에 하나입니다.

MLE의 방법을 통한 최적의 파라미터는 아래와 같은 절차로 구해집니다.

$$\underset{\Theta}{argmax}\, L(\Theta;x) = \underset{\Theta}{argmax}\, P(x|\Theta)$$

참고로 위 식에서 Theta는 파라미터를 뜻합니다.

위의 식이 의미하는 바는 조건부 확률(또는 조건부밀도함수) $$P(x|\Theta)$$를 최대화하는 Theta를 찾겠다는 것입니다.

P앞에 log를 붙이든 안붙이든 의미는 같습니다.(log는 증가함수이므로)

의미는 변하지 않지만 계산상의 이점으로 인해 위의 P에 log를 씌우기도 하는데, 바로 이를 log-likelihood라고 부릅니다.

뒤에 나올 예시에서도

$$\underset{\Theta}{argmax}\, L(\Theta;x) = \underset{\Theta}{argmax}\, P(x|\Theta)$$

대신

$$\underset{\Theta}{argmax}\, L(\Theta;x) = \underset{\Theta}{argmax}\, logP(x|\Theta)$$

를 사용할 것입니다.

예시를 보겠습니다.

확룰분포는 여러가지(ex. 베르누이, 푸아송분포, 정규분포..)가 있지만

여기서는 데이터가 정규분포를 따른다고 가정해봅시다.

(또한 데이터가 독립적으로 추출되었다고 가정합니다. 그 이유는 확률밀도의 곱의 법칙을 위해서 입니다. log-likelihood는 이 경우에 매우 유용합니다. log안의 곱셈들은 log + log + .. 의 형태로 변환시킬 수 있기 때문이죠...!)

그러면 MLE를 통해 파라미터(평균, 분산)을 구해보겠습니다.

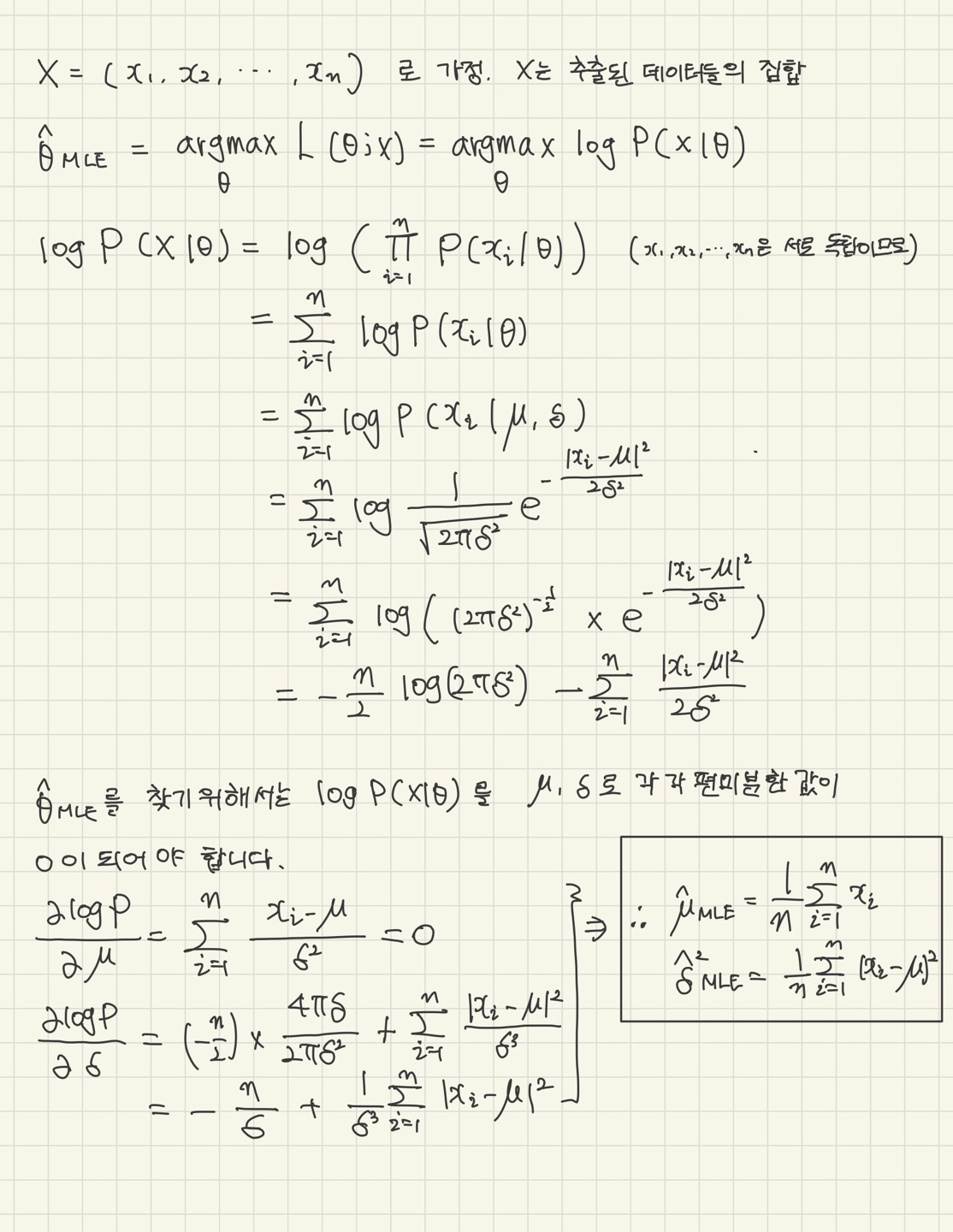

수식이 많이 들어있어서 손글씨로 대신 정리해봤습니다ㅎㅎ

모집단이 정규분포를 따른다고 가정했을때

MLE를 통해 구한 평균 파라미터값은 표본 데이터들의 평균이 되고,

분산 파라미터값은 표본 데이터들의 분산이 되네요.

지금까지 MLE에 대한 간단한 설명과 예제를 소개해드렸습니다.

'부스트캠프 AI Tech' 카테고리의 다른 글

| [4주차 - Day15] F1 Score (0) | 2021.08.23 |

|---|---|

| [4주차 - Day15] VSCode ssh 접속 (0) | 2021.08.23 |

| [2주차 - Day7] Gradient Descent Optimization Algorithms (0) | 2021.08.12 |

| [1주차 - Day5] Entropy, Cross-entropy (0) | 2021.08.06 |

| [1주차 - Day3] unittest, mock.patch (0) | 2021.08.04 |